¿Puede cansar físicamente hacer scroll durante mucho rato? La respuesta, según un nuevo trabajo europeo, es que sí puede haber un esfuerzo muscular medible detrás de gestos que parecen automáticos, como deslizar el dedo, tocar iconos pequeños o alcanzar una esquina de la pantalla. La herramienta se llama Log2Motion y usa inteligencia artificial para simular esos movimientos del móvil con una mano digital.

El avance no sirve para asustar a nadie por mirar el teléfono. Sirve, más bien, para poner números a algo que casi todos intuimos después de un rato con el móvil en la mano. Algunas interfaces obligan a estirar más el dedo, fallar más o repetir gestos, y eso puede marcar la diferencia en comodidad, accesibilidad y diseño.

La IA del cansancio digital

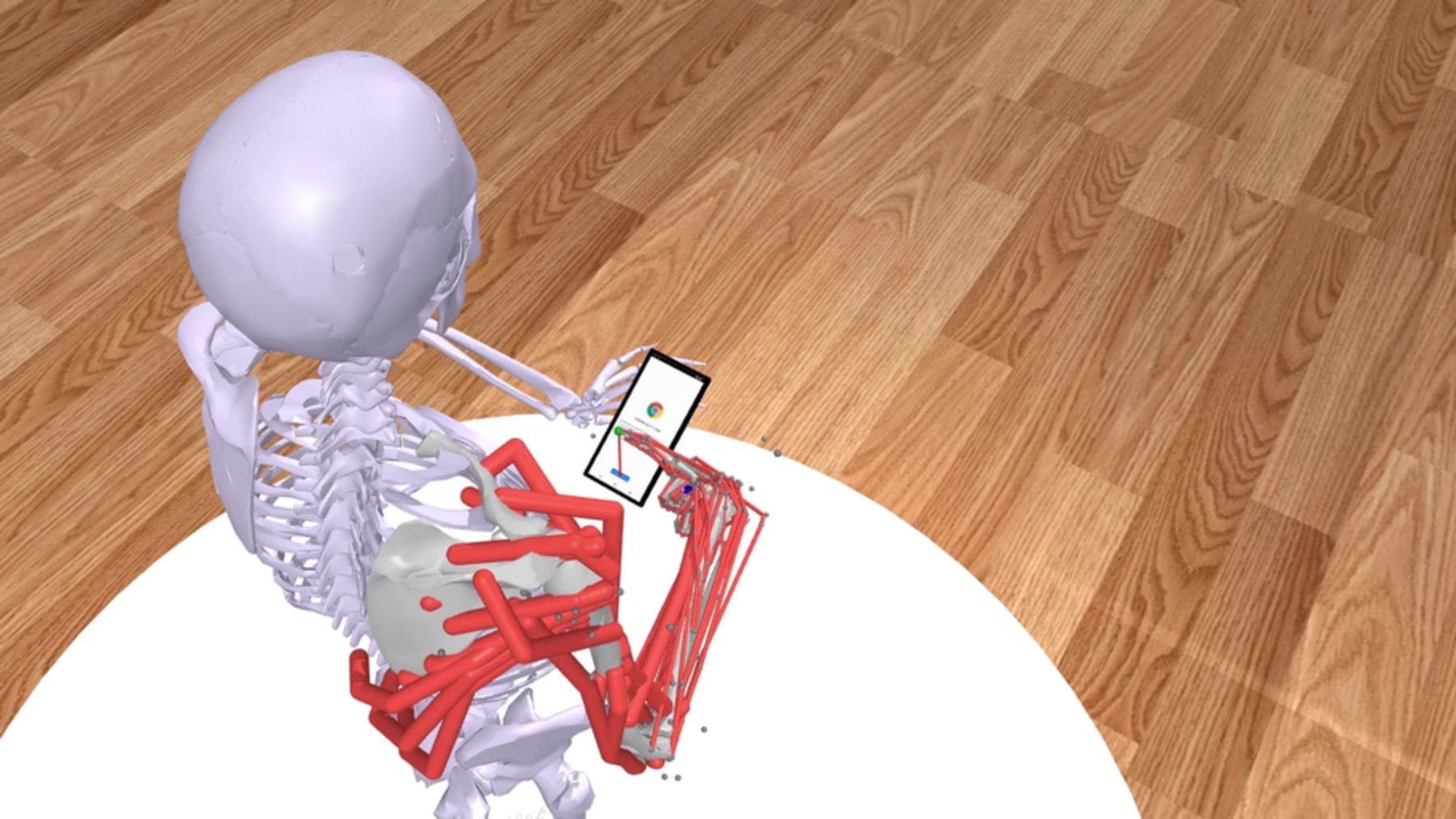

Log2Motion ha sido desarrollado por Michał Patryk Miazga, Hannah Bussmann, Antti Oulasvirta y Patrick Ebel, vinculados a ScaDS.AI y la Universidad de Leipzig, junto con la Universidad Aalto y ELLIS Institute Finland. Su idea es sencilla de explicar, aunque por dentro sea compleja. Donde antes solo se veía un toque en la pantalla, ahora se intenta reconstruir el movimiento físico que pudo producirlo.

El concepto clave es la simulación musculoesquelética. Dicho sin bata de laboratorio, es como crear una mano virtual con huesos, articulaciones y músculos, y pedirle que use una app real como lo haría una persona. Así, el sistema estima velocidad, precisión y esfuerzo muscular a partir de registros táctiles.

Cómo funciona Log2Motion

La herramienta traduce los registros del móvil, como taps y deslizamientos, en movimientos humanos probables. Para hacerlo, combina un emulador de Android con un simulador físico, de modo que el modelo digital puede interactuar con aplicaciones reales en tiempo real. No se queda en el punto de contacto, mira el camino que hace el dedo.

Antti Oulasvirta, profesor en la Universidad Aalto y en ELLIS Institute Finland, resumió el salto de forma clara. «Es la primera vez que alguien desarrolla una herramienta que puede ayudar a diseñadores y desarrolladores a evaluar rápidamente lo físicamente agotadora que puede ser una interfaz móvil real», explicó en la nota oficial de Aalto.

Qué gestos cuestan más

El equipo observó que algunos movimientos exigen más que otros. Los deslizamientos verticales, hacia arriba y hacia abajo, aparecen como gestos más duros de realizar que otras acciones habituales. También pesan más los iconos pequeños y los botones colocados cerca de las esquinas, justo esos que a veces obligan a hacer malabares con el dedo.

En las pruebas con botones muy pequeños, de cuatro milímetros de diámetro, el modo rápido falló en algo más de cuatro de cada diez intentos. Cuando el modelo actuaba con más precisión, los fallos bajaban a menos de uno de cada diez. Con botones de diez milímetros, los errores se quedaron en torno a dos de cada cien o menos.

También apareció un matiz interesante. Los gestos rápidos producen picos de esfuerzo más altos, como un tirón breve, pero consumen menos energía total que los gestos lentos y cuidadosos. En la práctica, eso ayuda a explicar por qué una tarea repetitiva puede cansar aunque cada toque parezca poca cosa.

Por qué importa para las apps

Para quienes diseñan aplicaciones, Log2Motion puede funcionar como una especie de prueba de comodidad antes de lanzar una interfaz. En vez de esperar a que los usuarios se quejen o abandonen una pantalla, el modelo permite detectar zonas problemáticas, botones difíciles y gestos que pueden aumentar el cansancio. No sustituye a las pruebas con personas, pero puede llegar antes.

La utilidad puede ser aún mayor en accesibilidad. Los investigadores plantean que el sistema podría adaptarse para simular a usuarios con temblores, menor fuerza muscular o prótesis. Para alguien con dificultades motoras, un icono mal colocado no es solo una molestia, puede ser una barrera diaria.

Lo que aún no mide

El trabajo tiene límites importantes. En su versión actual, Log2Motion se centra sobre todo en interacciones con el dedo índice y con el móvil colocado sobre una superficie, aunque los autores ya han probado cómo adaptar el entorno a posturas distintas. Es decir, todavía no captura toda la variedad real de cómo usamos el teléfono en el sofá, en la cama o de pie en el metro.

Aun así, esa flexibilidad es parte del valor del sistema. Patrick Ebel señaló que el modelo vive dentro de un simulador físico que permite cambiar el entorno y evaluar interacciones en situaciones distintas. «Podemos simular qué movimiento realizó el usuario y lo fatigoso que podría haber sido», explicó en la comunicación de ScaDS.AI.

El siguiente paso

Los autores creen que este tipo de simulación humana puede ayudar a diseñar interfaces más ergonómicas y agradables. También apuntan a una posible combinación con otros métodos de inteligencia artificial para personalizar la experiencia según las necesidades físicas de cada usuario. No es una promesa cerrada, pero sí una dirección clara.

El trabajo también deja una advertencia útil. Si una app obliga a repetir gestos incómodos, alcanzar esquinas o tocar objetivos diminutos, el problema quizá no esté en el usuario, sino en el diseño. A veces, la diferencia entre una pantalla cómoda y una frustrante cabe en unos pocos milímetros.

El trabajo oficial se ha publicado en Proceedings of the 2026 CHI Conference on Human Factors in Computing Systems.