¿Y si el mejor “programador” del mundo no fuera una persona, sino una inteligencia artificial? Esa idea ya no suena a ciencia ficción en muchas empresas. Kevin Weil, directivo de OpenAI, ha defendido que el gran cruce de líneas en programación competitiva podría llegar antes de lo que se venía pronosticando.

El mensaje se ha convertido en titular porque no habla de un avance suave, sino de un punto de no retorno. Según Weil, los modelos ganarían a humanos de forma estable en ciertas pruebas de programación. La palabra clave es pruebas, y ahí empieza la letra pequeña.

Quién es Kevin Weil

Weil llegó a OpenAI en 2024 como responsable de producto, un puesto que suele decidir qué se construye y cómo se convierte la investigación en herramientas útiles. No es el “creador” de ChatGPT, pero sí una figura visible en la etapa de expansión de la compañía.

Con el tiempo, OpenAI lo ha situado también en iniciativas de ciencia aplicada, una pista de por dónde cree la empresa que va el siguiente gran uso de estos modelos. En la práctica, su trabajo mezcla estrategia, producto y la parte incómoda de bajar promesas a algo que funcione.

La predicción en una frase

La frase que más se repite viene de una entrevista en YouTube en la que Weil respondió a un horizonte de 2027 para la automatización de la programación. “A este ritmo, me sorprendería que fuera 2027, creo que será antes”, dijo, y lo acotó a “benchmarks de programación competitiva”.

En publicaciones recientes, su comentario se ha presentado como una predicción centrada en 2026 y ligada a un programa de YouTube cuyo nombre se ha traducido de distintas maneras. Ese detalle parece menor, pero muestra lo fácil que es convertir un matiz en una cuenta atrás.

Qué es la programación competitiva

La programación competitiva es resolver problemas tipo puzle con reglas claras, tiempo limitado y una corrección automática. Plataformas como Codeforces organizan concursos frecuentes y asignan una puntuación que intenta reflejar el nivel de cada participante.

Ese sistema de puntuación se inspira en ideas similares a las del ajedrez, donde ganas o pierdes nivel según con quién compites y cómo quedas. Es útil porque convierte una habilidad compleja en un número fácil de comparar, aunque no capture todo lo que pasa en un proyecto real.

Además, cuando se habla de una IA con “rating” alto, no siempre está claro cómo se calcula esa equivalencia con humanos. La propia comunidad de Codeforces ha señalado que falta detalle público sobre la metodología de algunos anuncios y que conviene leer esas cifras con prudencia.

Lo que muestran los benchmarks de OpenAI

En una charla del OpenAI Forum, Weil puso números concretos sobre la mesa. Dijo que o1 rondaba una puntuación alta en Codeforces y que o3 subía a un nivel que lo situaría cerca del top mundial, alrededor del puesto 175, con modelos internos apuntando incluso más arriba. También habló de una mejora grande en SWE-bench Verified, una prueba centrada en arreglar tareas de software más parecidas a las del trabajo real.

¿Significa eso que la IA ya puede reemplazar a cualquier programador en cualquier empresa? No necesariamente. Un concurso no tiene cambios de última hora, ni deuda técnica, ni un servidor viejo que falla justo cuando nadie mira.

SWE-bench y el salto al mundo real

SWE-bench es un banco de pruebas que usa incidencias reales de proyectos de código abierto, de esas que se escriben en GitHub cuando algo falla. OpenAI presentó la versión Verified en agosto de 2024 como un subconjunto revisado por personas para hacer la evaluación más fiable.

La web del proyecto mantiene un panel comparativo que permite ver resultados de distintos modelos con un método de evaluación común. En pocas palabras, intenta medir si un sistema no solo “sabe programar”, sino si puede arreglar un bug de verdad sin romper el resto.

Aun así, pasar una prueba no equivale a hacerse responsable de un producto. El software que usamos cada día no se valora solo por funcionar, también por ser mantenible, seguro y entendible por otras personas dentro de seis meses.

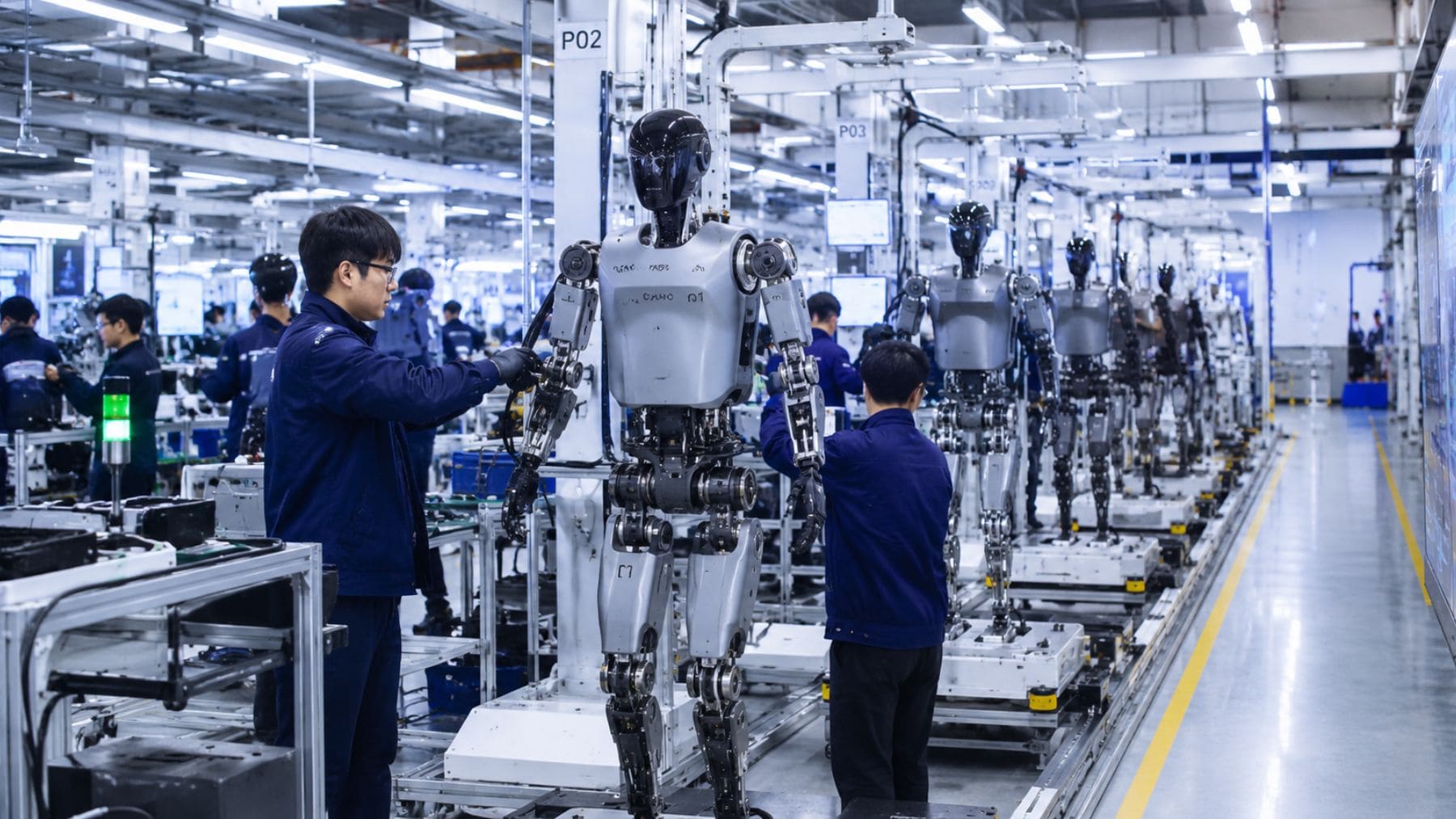

Qué cambia en el trabajo y qué no

Una forma sencilla de verlo es esta. La tarea de teclear código puede bajar, pero la tarea de pensar sistemas sube de valor. Bret Taylor, presidente de OpenAI, lo resumió defendiendo que estudiar informática sigue siendo útil aunque el futuro sea menos “escribir” y más “dirigir” herramientas de IA.

En paralelo, otras empresas ya describen el cambio como algo práctico, no como una promesa futura. Un informe de Anthropic explica que sus equipos usan Claude sobre todo para entender bases de código y arreglar errores, justo el tipo de trabajo que suele consumir horas sin gloria.

Y aun con cifras espectaculares circulando, medir “cuánto código escribe la IA” sigue siendo resbaladizo. Un análisis de Redwood Research mostró que el famoso “90%” depende mucho de cómo cuentes, si vale con que la IA sugiera y un humano edite, o si hablas de cambios que se incorporan tal cual.

La entrevista principal se ha publicado en el canal de YouTube Overpowered.