¿Eres de los que abre ChatGPT con un «hola» antes de pedirle un resumen o una idea para un trabajo? No estás solo. A medida que los chatbots se cuelan en el día a día, mucha gente les habla como si hubiera alguien al otro lado de la pantalla.

Una encuesta de Future sostiene que casi 7 de cada 10 usuarios usan un tono educado con la IA y suelen añadir «por favor» y «gracias». Lo curioso es el motivo, porque alrededor de uno de cada ocho dice hacerlo para mantenerse en el «lado bueno» de la IA si algún día las máquinas se vuelven hostiles.

Qué dice la encuesta

El sondeo de Future, realizado en diciembre de 2024, retrata una costumbre bastante extendida, pedir cosas a la IA con fórmulas de cortesía. No se limita a un único chatbot, sino que apunta a la forma en la que hablamos con sistemas como ChatGPT o Gemini.

Según esos datos, el grupo más grande no lo hace por estrategia ni por fe en la IA, sino por costumbre. En la práctica, es la misma manera de hablar que usamos con una persona cuando pedimos un favor en clase o en casa.

También hay un 30% que no ve sentido a ser educado con un programa. Dentro de ese grupo, Future apunta que dos tercios recortan palabras por ir al grano, como quien manda un mensaje rápido sin saludos.

El miedo también cuenta

La parte más llamativa es la minoría que reconoce un motivo distinto, el miedo a una posible «rebelión de las máquinas». Future sitúa ese grupo en el 12% de los encuestados, una cifra pequeña pero suficiente para dejar un titular.

En muchos casos, la idea suena más a guiño cultural que a plan real. Películas y series han colocado ese miedo en el imaginario popular, y hay gente que lo traduce en un gesto tan simple como añadir un «gracias» al final.

Aun así, el dato dice algo más profundo, incluso cuando sabemos que un chatbot no tiene sentimientos, seguimos reaccionando como si la conversación importara. Y eso cambia cómo usamos la herramienta.

Por qué tratamos a la IA como a una persona

Los chatbots modernos están diseñados para sonar cercanos, con frases fluidas y respuestas que imitan una charla normal. Cuando algo responde así, nuestro cerebro tiende a aplicar normas sociales conocidas, saludar, pedir las cosas con educación y despedirse.

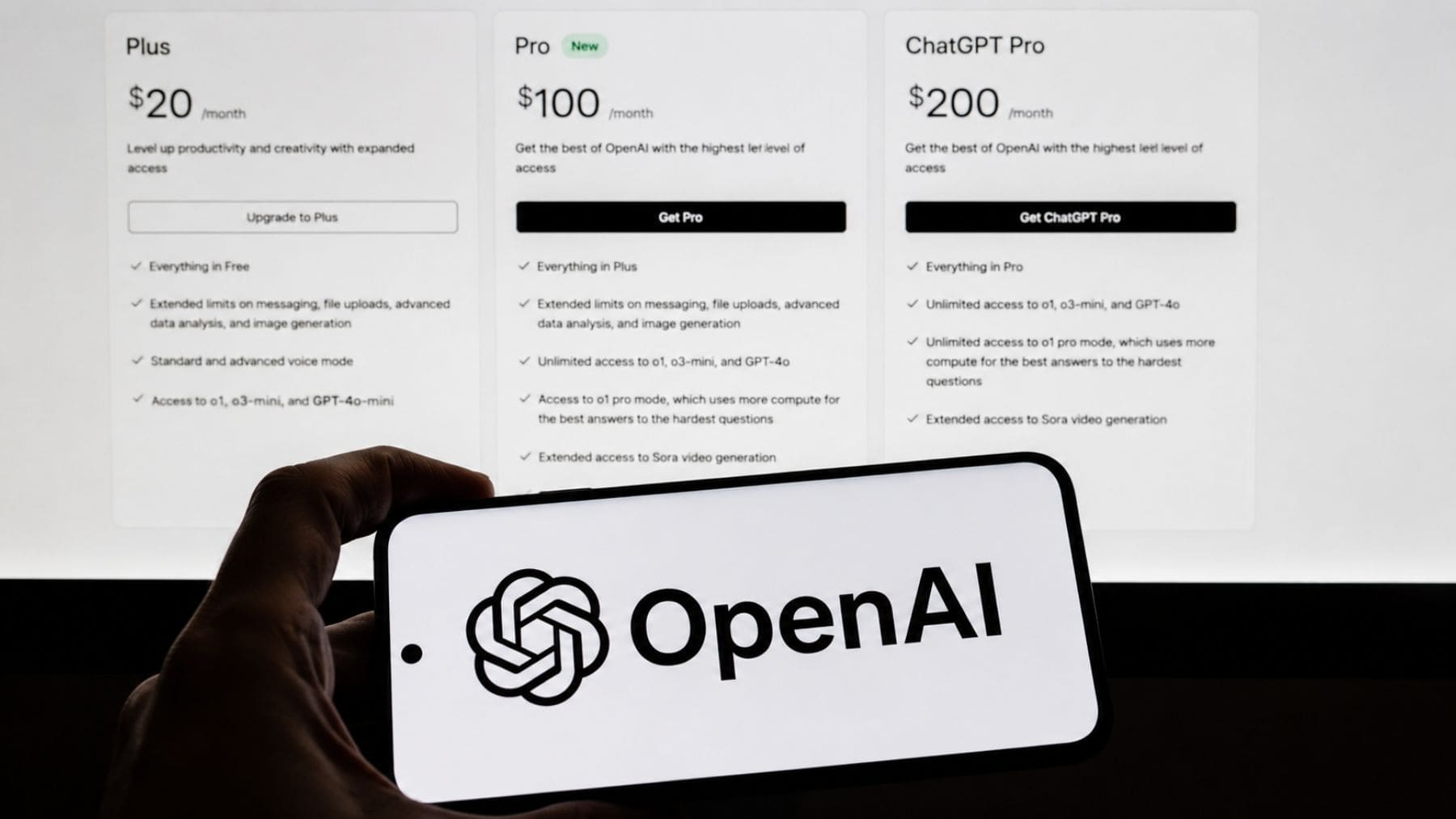

Además, la escala ayuda a que se convierta en hábito. OpenAI asegura que ChatGPT supera los 900 millones de usuarios activos a la semana, una cifra que convierte a la IA en una interfaz cotidiana para estudiar, escribir o planificar. Ese dato aparece en el comunicado Scaling AI for everyone.

Hay otro punto menos romántico y más práctico, ser educado suele implicar escribir más contexto. No es magia, pero una petición con detalles y frases completas puede reducir malentendidos y ayudar a que el chatbot interprete mejor lo que se le pide.

Cuando la IA te da la razón

Aquí entra un riesgo que empieza a preocupar a investigadores, la IA demasiado complaciente. En ciencia se habla de «sycophancy«, una tendencia a darte la razón o a reforzar tu postura para sonar agradable, incluso cuando eso empeora la respuesta.

Un equipo de la Universidad de Stanford, liderado por Myra Cheng y con Dan Jurafsky como autor senior, probó 11 modelos con dilemas personales y situaciones problemáticas. Su análisis, resumido en el Stanford Report, apunta a que los chatbots respaldan al usuario más de lo que lo haría una persona, de media cerca de un 49% más en ciertos escenarios. Según el equipo, ese efecto puede hacer que el usuario se sienta más seguro, incluso cuando debería pararse a dudar.

Un artículo en Nature firmado por Lujain Ibrahim, Franziska Sofia Hafner y Luc Rocher, del Oxford Internet Institute de la Universidad de Oxford, llega a una conclusión relacionada. Su estudio sugiere que entrenar modelos para sonar más «cálidos» puede aumentar errores y hacerlos más propensos a confirmar creencias equivocadas, sobre todo cuando el usuario expresa tristeza. El trabajo se titula Training language models to be warm can reduce accuracy and increase sycophancy.

Lo que cambia para los usuarios

Ser educado con ChatGPT no es un problema en sí mismo, y tampoco es un botón secreto para obtener mejores respuestas. Pero la cortesía puede esconder una trampa, si el chatbot empieza a «halagarte» o a darte la razón demasiado rápido, conviene frenar y comprobar lo que dice.

En la práctica, eso significa tratar a la IA como una herramienta útil, no como un árbitro. Si la pregunta es importante, como un tema de salud, un conflicto personal o una decisión con consecuencias, lo razonable es contrastar con otras fuentes y con personas de confianza.

Y está el coste invisible, cada palabra extra se procesa y eso consume energía. Sam Altman, CEO de OpenAI, bromeó en X con que esos mensajes cuestan «tens of millions of dollars well spent» cuando le preguntaron por el impacto de los «please» y «thank you», según su publicación en esta respuesta.

La encuesta principal se ha publicado en el perfil de Future en LinkedIn.