Durante años, los generadores de imágenes han sido perfectos para sorprender. Pero cuando intentas hacer algo usable, como un cartel, una viñeta o una infografía, casi siempre pasa lo mismo, el texto sale torcido, con letras inventadas o palabras a medias.

OpenAI quiere que ese momento de frustración sea menos frecuente. ChatGPT Images 2.0 pone el foco en imágenes útiles, con más control sobre el resultado, mejor organización visual y un salto en el texto dentro de la imagen. Y además añade un concepto que suena raro, pero cambia el ritmo, “imágenes con razonamiento”.

Qué se ha anunciado

OpenAI ha incorporado ChatGPT Images 2.0 como su nuevo modelo de generación de imágenes dentro de ChatGPT. Según las notas de versión publicadas el 21 de abril de 2026, está disponible en todos los planes, y la función de “imágenes con razonamiento” se activa al elegir modelos Thinking y Pro en los planes de pago.

Para quien desarrolla productos, el mismo lanzamiento llega con nombre propio. En la comunidad de desarrolladores, OpenAI presenta gpt-image-2 como “OpenAI’s most capable image generation model yet” y lo ofrece “hoy” tanto en la API, la interfaz para integrarlo en apps, como en Codex, su entorno para programar con ayuda de IA.

Por qué fallaban las letras

El problema de las letras es más grande de lo que parece. Un modelo puede “entender” que un póster necesita un título arriba y un precio abajo, pero dibujar tipografía exige precisión.

Ahí es donde muchos sistemas tropiezan. Basta un trazo mal colocado para que una “a” deje de ser una “a” y el mensaje se rompa, y eso se nota más que un fallo en una sombra o en una textura.

Imágenes con razonamiento

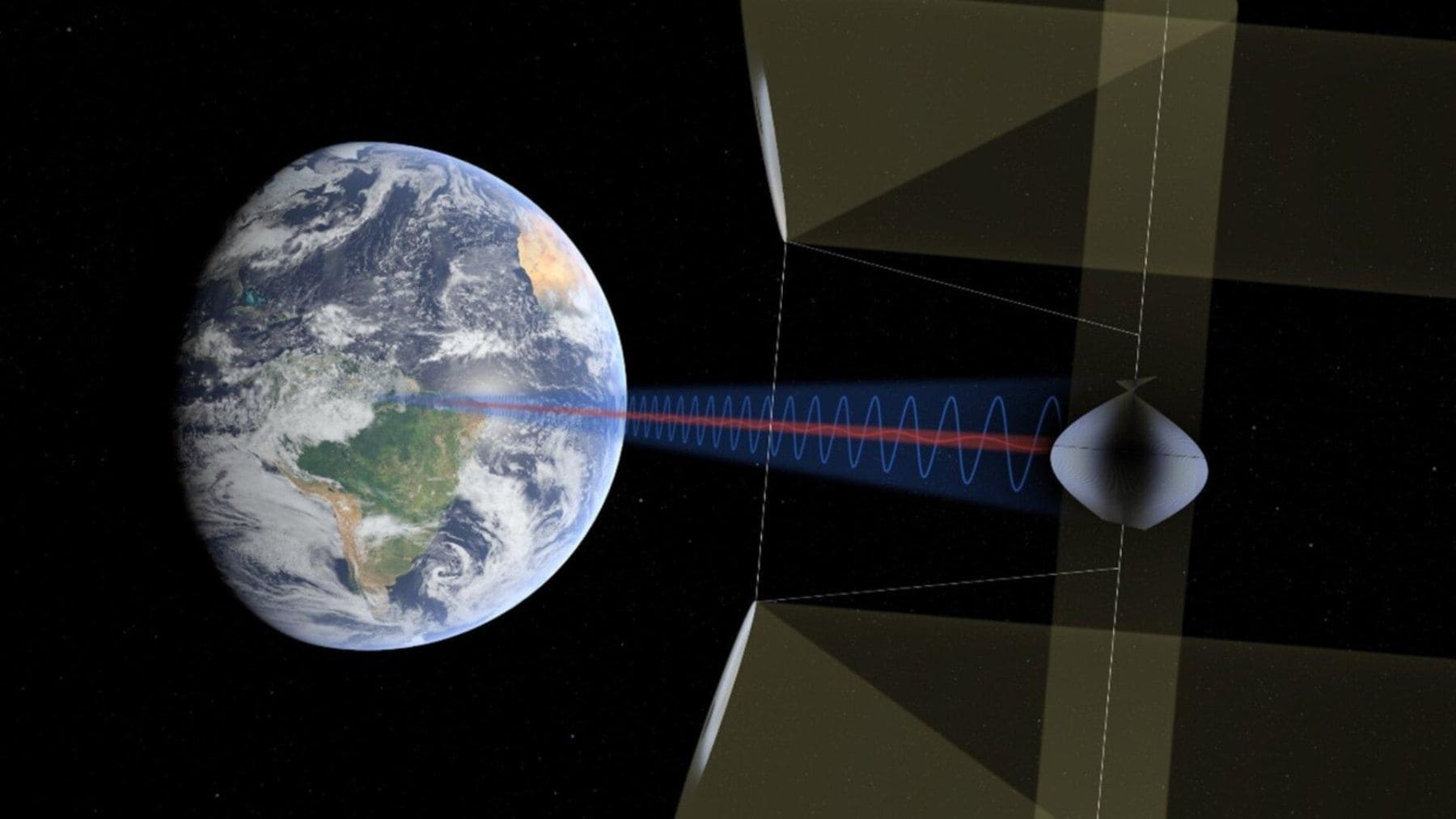

“Imágenes con razonamiento” significa, en la práctica, que el sistema puede dedicar más pasos a planificar antes de dibujar. Primero organiza la escena, decide qué va dónde y luego genera la imagen con esa estructura en mente.

En la guía técnica de OpenAI, firmada por Mandeep Singh y Emre Okcular, aparecen ejemplos donde el modelo usa contexto y “world knowledge” para completar escenas de forma coherente. También se describe un detalle muy práctico, pedir varias variaciones en una sola solicitud con el parámetro n, que básicamente es decir cuántas opciones quieres de golpe.

Formatos y resolución

Otra limitación típica era el tamaño. Muchos generadores rendían bien en un cuadrado para redes sociales, pero se caían cuando tocaba hacer un banner o una imagen muy vertical para móvil.

La documentación de OpenAI abre más opciones de tamaño y permite llegar hasta resoluciones tipo 2K y 4K. Aun así marca un límite para que una imagen no sea exageradamente alargada, el lado largo no puede ser más de tres veces el corto. Y avisa de algo importante para la vida real, algunas peticiones complejas pueden tardar hasta dos minutos, y aunque el texto ha mejorado mucho, todavía puede fallar en claridad o en colocación exacta.

Más idiomas, más guion

OpenAI también intenta atacar otro punto débil que muchos usuarios notan rápido. No es lo mismo poner dos palabras en inglés que escribir un párrafo con caracteres de otros alfabetos, donde cualquier error destaca aún más.

En su propia galería de ejemplo, la compañía muestra texto multilingüe y composiciones con escritura japonesa, árabe, coreana, devanagari, cirílico, bengalí, griego, chino y alfabeto latino. La idea es que un cartel o una ficha informativa no se rompa en cuanto cambias de idioma.

Una carrera con más jugadores

Este movimiento llega en un mercado donde nadie está quieto. Google DeepMind impulsa su modelo Gemini Image, conocido por el nombre Nano Banana Pro, y lo promociona como una herramienta capaz de generar “clear text” para pósters y diagramas, justo el terreno donde se estaban acumulando quejas.

También hay jugadores más enfocados en producción creativa. Black Forest Labs presenta FLUX.2 como un modelo pensado para flujos de trabajo reales, con consistencia de estilo y capacidad para manejar texto, diseño y logos de forma más predecible. Midjourney, por su parte, se define como un “community-funded research lab” y sigue siendo una referencia cuando el objetivo es un acabado artístico muy marcado.

Para entender el salto, conviene mirar atrás. El 16 de diciembre de 2025, OpenAI ya había renovado Imágenes en ChatGPT y había llevado su modelo GPT-image-1.5 a la API, con mejoras en ediciones y en renderizado de texto respecto a versiones anteriores. ChatGPT Images 2.0 llega ahora como el siguiente intento de convertir lo vistoso en utilizable, sobre todo cuando hay letras de por medio.

La nota oficial se ha publicado en OpenAI.