Liam Price tiene 23 años, no cuenta con formación matemática avanzada y, aun así, acabó en mitad de una historia que ha sacudido a la comunidad matemática. Metió en ChatGPT un problema de Erdős que llevaba décadas abierto y el modelo devolvió una idea que, aunque estaba lejos de ser una demostración limpia, apuntaba en la dirección correcta.

El resultado afecta al problema 1196 de Erdős, una conjetura sobre conjuntos primitivos de números enteros planteada en 1966. La clave no está solo en que GPT-5.4 Pro ayudara a resolverlo, sino en cómo lo hizo, usando un camino que los especialistas no habían probado.

Qué se resolvió

Un conjunto primitivo es una lista de números enteros en la que ningún número divide exactamente a otro. Por ejemplo, si uno estuviera ordenando cromos con una regla muy estricta, no podría meter dos piezas cuando una encaja dentro de la otra de forma perfecta.

El problema estudiaba cómo se comporta una especie de «puntuación» asociada a esos conjuntos cuando los números se hacen cada vez más grandes. En la página Erdős Problems, el problema 1196 aparece como una conjetura de Paul Erdős, András Sárközy y Endre Szemerédi, y se indica que fue resuelto con GPT-5.4 Pro a partir de una indicación de Price.

La jugada de GPT-5.4

Price no conocía toda la historia del problema cuando lo introdujo en ChatGPT. Después envió la respuesta a Kevin Barreto, estudiante de Matemáticas en la Universidad de Cambridge, que vio que aquello podía ser más serio de lo que parecía.

La idea nueva usó pesos de von Mangoldt, una herramienta clásica de teoría de números relacionada con los números primos. Dicho sin jerga, el modelo encontró una forma distinta de medir el papel de ciertos números dentro del problema, como cambiar de mapa cuando todos están mirando la misma carretera.

Por qué sorprendió

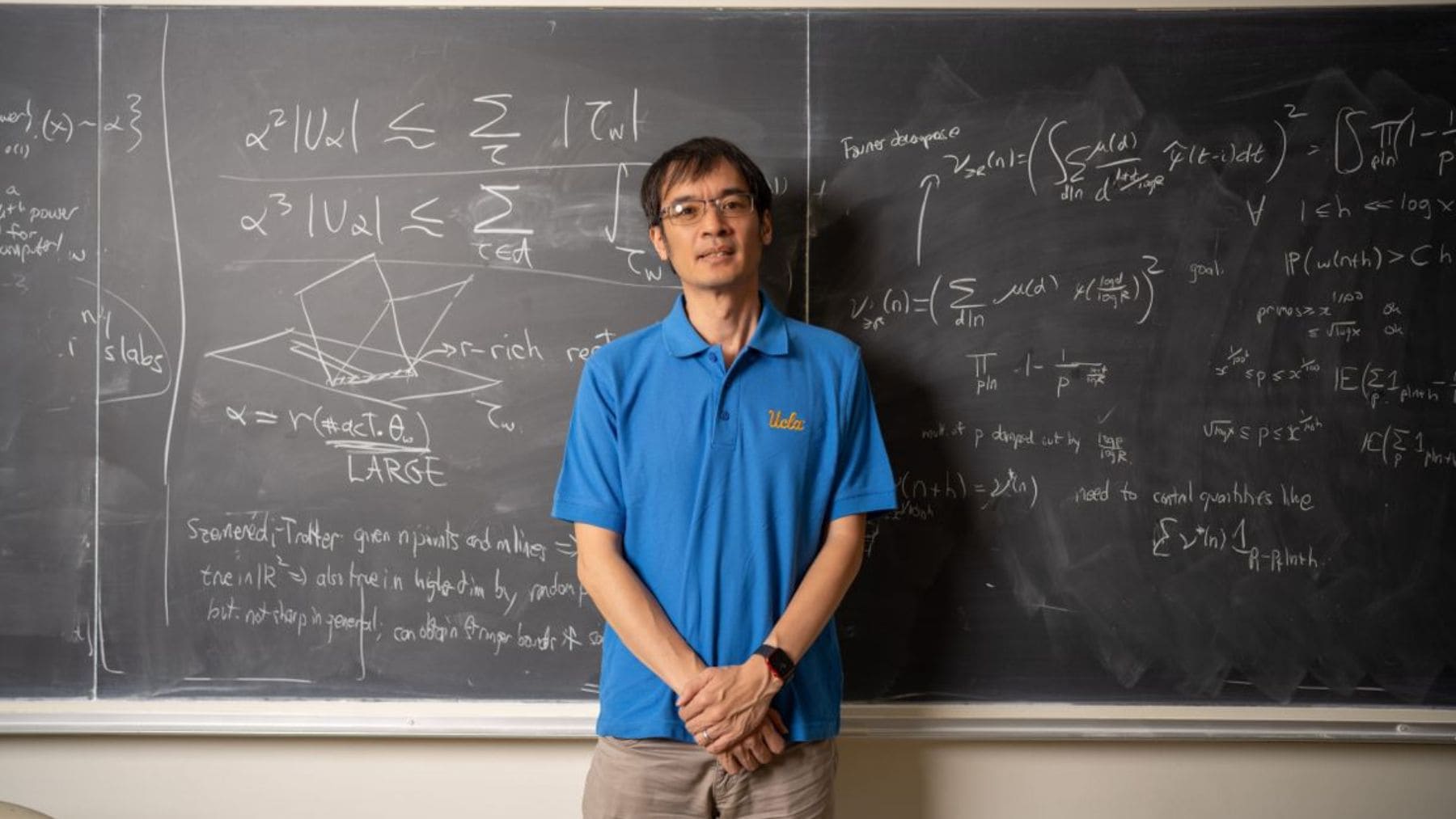

Terence Tao, matemático de la Universidad de California en Los Ángeles, explicó que muchos expertos habían arrancado desde el mismo punto porque parecía el paso natural. Según Tao, hubo una especie de bloqueo colectivo y el modelo no heredó ese hábito.

Jared Duker Lichtman, matemático de Stanford, fue todavía más prudente. Dijo que «la salida en bruto de ChatGPT era bastante pobre», así que hizo falta trabajo experto para separar el ruido de la idea útil. Ese matiz cambia mucho la lectura del caso.

No fue una IA sola

El registro de contribuciones de IA a problemas de Erdős, mantenido en GitHub por el entorno de Terence Tao y Nat Sothanaphan, no presenta estos avances como una tabla definitiva de éxitos. De hecho, advierte que no es un benchmark y que hay sesgo de selección, porque los fracasos suelen publicarse mucho menos que los aciertos.

También clasifica una entrada relacionada con el problema 1196 dentro de la categoría de colaboración entre humanos e IA, donde la participación humana es significativa. En la práctica, eso significa que el modelo propuso una ruta, pero matemáticos como Tao, Lichtman y otros tuvieron que revisar, depurar y convertir la pista en una demostración aceptable.

El aviso previo

El entusiasmo con la IA en matemáticas ya venía con un golpe reciente. En 2025, una afirmación sobre GPT-5 y varios problemas de Erdős recibió críticas porque el modelo no había resuelto problemas nuevos, sino encontrado referencias a soluciones ya existentes.

Por eso este caso se mira con lupa. La diferencia es que aquí el trabajo posterior apunta a una idea matemática reutilizable, no a una simple búsqueda bibliográfica. Aun así, el mensaje de fondo sigue siendo incómodo para el hype rápido. Primero hay que verificar. Luego, si aguanta, celebrar.

Cómo se está midiendo

La iniciativa First Proof intenta poner orden en esta discusión. Un grupo de once matemáticos, entre ellos Mohammed Abouzaid de Stanford, Lauren Williams de Harvard y Daniel Spielman de Yale, reunió diez problemas nacidos en investigación real para probar si los sistemas de IA podían producir pruebas autónomas.

OpenAI publicó sus propios intentos y reconoció que el proceso no fue tan limpio como debería ser en una evaluación controlada. Al mismo tiempo, First Proof prepara una segunda tanda con revisión humana ciega y criterios más parecidos a los de una revista científica.

Qué cambia ahora

El trabajo final sugiere que la idea de GPT-5.4 Pro no solo sirve para el problema 1196. El preprint firmado por Boris Alexeev, Kevin Barreto, Yanyang Li, Jared Duker Lichtman, Liam Price, Jibran Iqbal Shah, Quanyu Tang y Terence Tao afirma que el método también aporta avances en otros problemas relacionados con conjuntos primitivos y cadenas de divisibilidad.

¿Revolución matemática? Todavía es pronto. Pero el caso enseña algo útil y bastante humano, que a veces no hace falta ser más listo, sino empezar por un sitio que nadie estaba mirando.

El trabajo principal ha sido publicado en arXiv.